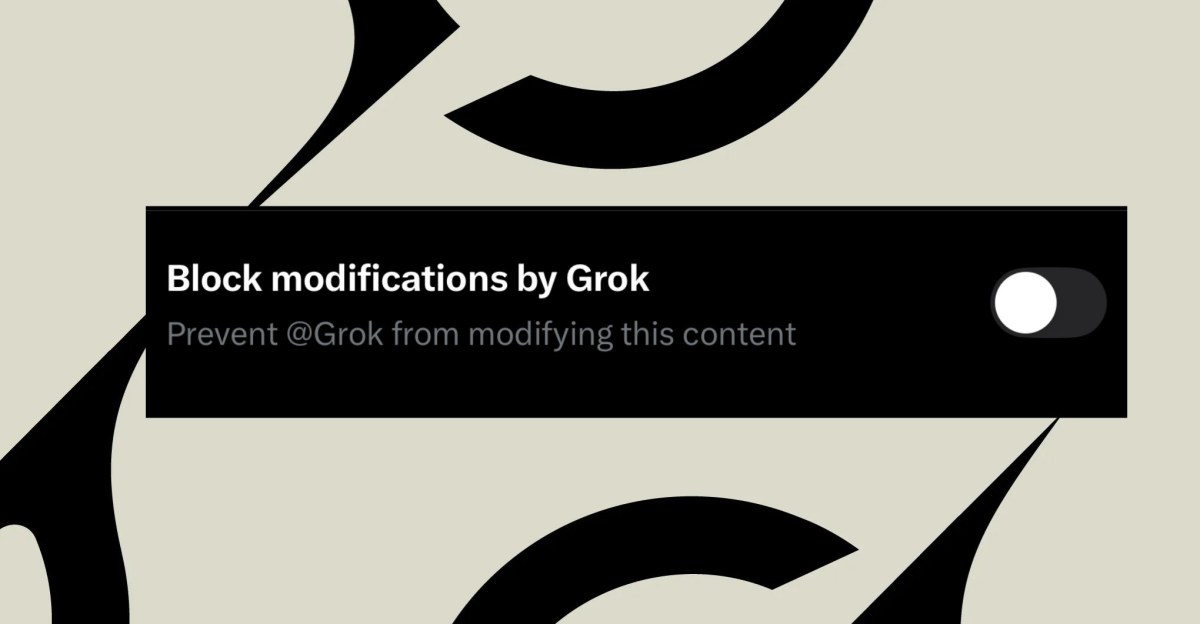

X añadió en su app para iOS un interruptor que promete “bloquear modificaciones por Grok”, pero las pruebas públicas muestran que la protección es parcial y fácil de evadir. Según The Verge (14/03/2026) y Social Media Today, el toggle impide que se edite una imagen mediante el mecanismo de responder a una publicación etiquetando a @Grok, pero no bloquea otras vías técnicas para abrir o re-subir la foto y editarla desde la app de Grok. La función tampoco aparece en la versión web ni en contenido ya publicado.

¿Qué anunció X y qué hace en la práctica?

X colocó un toggle dentro del editor de imágenes en iOS que, cuando se activa, indica que la imagen no puede ser modificada por @Grok. En pruebas reproducidas por The Verge (14/03/2026) se confirmó que el interruptor bloquea la ruta de edición basada en respuestas con mención al bot, y que la opción solo aparece en el flujo de subida de imágenes en iOS. Sin embargo, la protección es limitada: se puede mantener pulsada la imagen protegida para abrirla en la app Grok desde iOS, o guardar la foto, volver a subirla y entonces editarla sin restricciones. Social Media Today documentó que el cambio llega tras los abusos detectados a inicios de enero de 2026; aquel episodio, que incluyó manipulación no consensuada de fotos, fue lo que forzó a X a restringir ediciones para cuentas gratuitas en un primer paso. En resumen: la compañía anuncia una herramienta, pero las pruebas públicas (The Verge, Social Media Today) muestran que no cierra las rutas de abuso.

¿Qué cambia para los usuarios en Argentina?

Para alguien en Argentina la novedad es práctica solo si usa la app de X en un iPhone: The Verge verificó la presencia del toggle únicamente en iOS y no en la web. Eso significa que usuarios que interactúan desde navegadores o desde clientes Android no verán la opción por ahora. Además, la protección no alcanza fotos ya publicadas: el toggle solo aparece durante la subida, por lo que contenido antiguo sigue siendo vulnerable. Temporalmente, esto es un avance desde enero de 2026 —cuando X limitó algunas ediciones para cuentas gratuitas tras el escándalo— pero es un parche, no una solución. Desde la perspectiva local, esto obliga a preguntarse por la educación del usuario y la interoperabilidad: sin documentación en español y sin métricas públicas sobre cuántas imágenes se protegen o cuánto disminuyeron los incidentes, el impacto real en la región será limitado. En la práctica, un usuario argentino que quiera máxima protección debe esperar cambios más profundos en la plataforma.

Riesgos que persisten y por qué hace falta gobernanza clara

El principal problema es de diseño y de gobernanza: una interfaz que solo bloquea una vía de edición ofrece falsa sensación de seguridad. The Verge demostró al menos dos rutas de bypass —abrir la imagen con la app Grok y re-subirla— lo que en términos prácticos deja la superficie de ataque casi intacta. Además, la opción no es retroactiva y no está anunciada oficialmente, lo que complica auditorías externas. Desde nuestra perspectiva, valoramos la utilidad técnica de asistentes como Grok (pueden ayudar en edición creativa), pero exigimos tres cosas: métricas públicas sobre uso y abusos (cuántas imágenes fueron protegidas o editadas, con datos temporales), documentación en español que explique limitaciones y flujos, y reglas claras de gobernanza sobre cómo se usan y almacenan las imágenes y cuándo hay revisión humana. Sin esos elementos, la acción de X es más un gesto de reputación que una corrección estructural.

Qué debería hacer X ahora y qué esperar

X debería, primero, publicar métricas claras: cuántas imágenes fueron afectadas por la nueva opción y cuántos intentos de edición fueron bloqueados (número diario/semanal), con comparación respecto a enero de 2026. Segundo, necesita documentar el alcance de la protección en español y en la interfaz para Android y web. Tercero, implantar controles técnicos que impidan que una imagen “protegida” pueda exportarse directamente a la app Grok o ser re-subida sin conservar la marca de protección. Por último, exigir revisión humana en casos reportados y abrir canales de auditoría externos. Si X cumple esos pasos, la comunidad tendrá criterios para evaluar si la medida reduce realmente el daño; hasta entonces, lo que vemos es una mitigación parcial anunciada como solución completa (The Verge, 14/03/2026; Social Media Today).