Ulysses Sequence Parallelism es una técnica para entrenar modelos con contextos extremadamente largos que, en los experimentos reportados por Hugging Face, permitió procesar hasta 96.000 tokens en 4 GPUs H100 80GB y reducir la memoria por GPU en ~3.3× respecto a data-parallel (Hugging Face blog, 9/3/2026). Vemos que la clave no es eliminar el coste computacional del attention —que sigue siendo O(n^2) en FLOPs— sino repartir esa carga entre GPUs mediante particionado de cabezas y secuencias, lo que baja el requerimiento de memoria por dispositivo y hace factible el entrenamiento en long-contexts a escala práctica.

¿Qué es Ulysses y por qué importa?

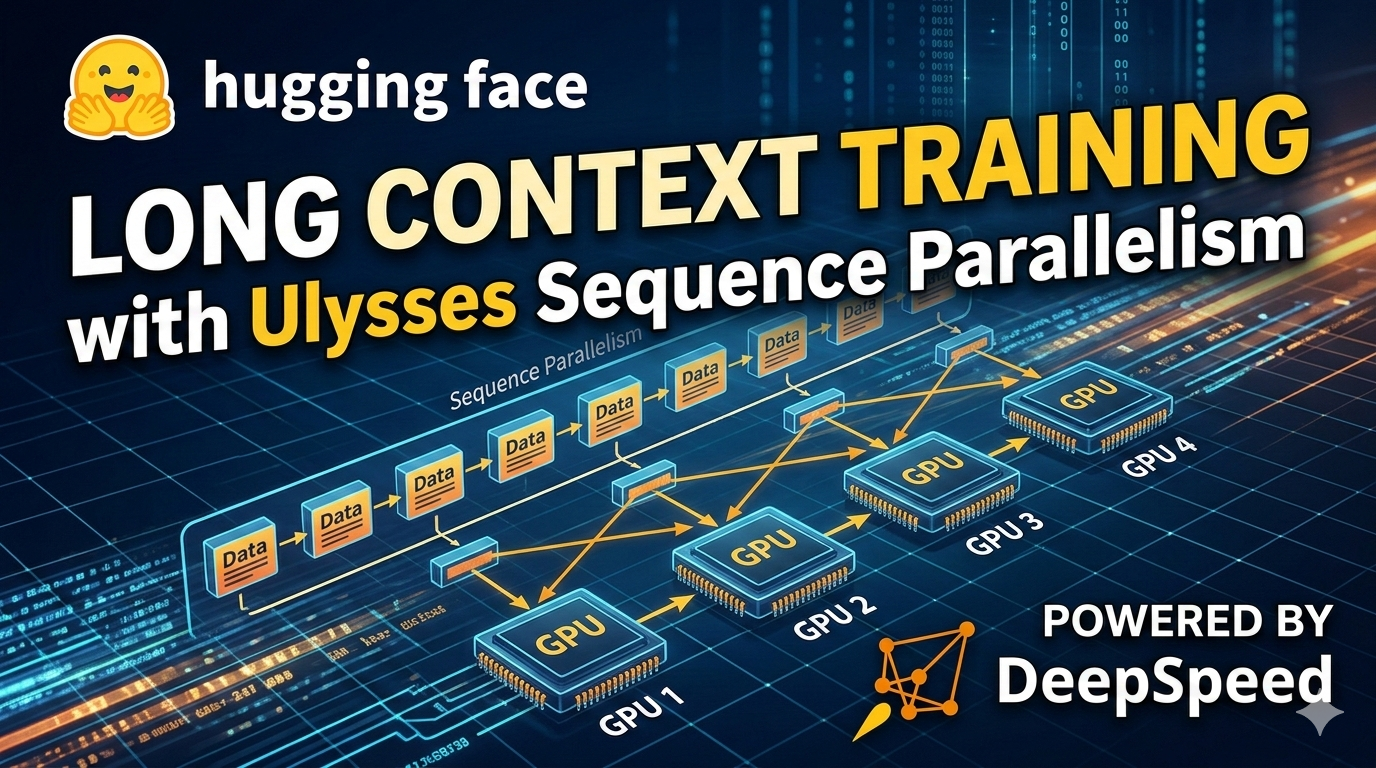

Ulysses combina shardings en la dimensión de secuencia con particionado de attention heads: cada GPU calcula QKV para su trozo de secuencia, hace dos operaciones all-to-all por capa y cada nodo procesa solo un subconjunto de cabezas, según la explicación técnica citada por Hugging Face (9/3/2026) y el Snowflake Engineering Blog. Ese diseño cambia la limitación clásica: en vez de que cada GPU necesite la matriz de atención completa (O(n^2) memoria), la comunicación total por GPU queda en O(n·d/P) con P GPUs, frente a O(n·d) de Ring Attention (Hugging Face, 9/3/2026). Para traducirlo: un libro promedio son ~250.000 tokens (según el blog de Hugging Face, 9/3/2026), y Ulysses hace plausible entrenar en entradas de múltiples documentos o libros completos donde antes la memoria lo impedía.

¿Qué cambia en la práctica de entrenamiento (y cuáles son los límites)?

En la práctica Ulysses permite escalar la longitud de secuencia mucho más allá de límites previos en setups similares: en los benchmarks de Hugging Face con H100 80GB, el modo SP=4 llegó a 96K tokens por secuencia antes de hacer OOM; el baseline sin SP se quedaba en 8K (Hugging Face, 9/3/2026). En throughput, SP=4 a 64K logró 13.396 tokens/s frente a 3.633 tokens/s del baseline en 8K, lo que demuestra que a medida que la etapa de attention domina el cómputo, repartir la secuencia es más eficiente (Hugging Face, 9/3/2026). Hay, sin embargo, restricciones prácticas: Ulysses requiere num_heads >= sp_size y soporte DeepSpeed (versiones mínimas reportadas: deepspeed>=0.18.1, accelerate>=1.12), además de enlaces NVLink para que el all-to-all no se vuelva cuello de botella (Hugging Face, 9/3/2026).

¿Cómo impacta esto en el mercado argentino?

Para equipos y empresas en Argentina el avance es relevante pero con matices: la técnica demuestra que con 4 GPUs H100 80GB (hardware usado en los tests) se puede entrenar hasta 96K tokens, pero ese hardware no es commodity en la región y suele estar disponible sobre todo en instancias cloud o centros especializados (Hugging Face, 9/3/2026). Vemos dos efectos claros: primero, investigación y productos que necesitan entender libros enteros o bases legales se vuelven viables técnicamente; segundo, los costos y la disponibilidad de H100/NVLink —y la complejidad de configurar DeepSpeed/Accelerate— siguen siendo barreras prácticas para startups sin acceso a infraestructura. Por eso valoramos este avance técnico, pero exigimos métricas públicas, disponibilidad regional y gobernanza clara sobre revisión humana y uso comercial de datos, tal como hemos planteado en posiciones previas sobre actores del ecosistema.

Conclusión rápida

Ulysses no cambia la matemática fundamental del attention, pero sí desplaza la limitación práctica: donde hace dos años muchas implementaciones comerciales se quedaban en 8–32K tokens, ahora hay una vía técnica para entrenar en decenas o centenas de miles de tokens usando SP=4 o SP=8 y 2D parallelism (Hugging Face, 9/3/2026). Recomendamos a equipos en LATAM probar Ulysses en pruebas controladas, medir throughput y memoria en su infraestructura y exigir a proveedores métricas reproducibles y disponibilidad regional antes de apostar producción completa.