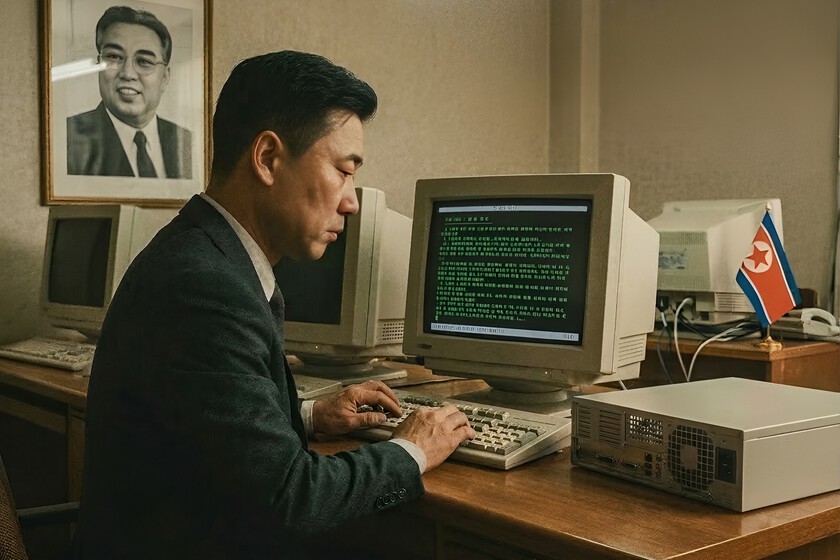

Se trata de redes que crean “empleados” falsos para entrar en empresas tecnológicas: según el Departamento de Justicia, operativos consiguieron infiltrarse en más de 300 compañías entre 2020 y 2024 y generaron al menos US$6,8 millones (Department of Justice, citado por Financial Times). El mecanismo usa perfiles legítimos, lenguaje artificial y hardware remoto para cobrar sueldos, robar datos o instalar malware.

¿Qué está pasando y por qué importa?

Los informes públicos muestran un patrón claro: construcción de identidades convincentes, uso de cuentas inactivas de LinkedIn y apoyo de modelos de lenguaje para redactar currículums y mensajes. El Financial Times documenta además el uso de avatares, máscaras de vídeo y la existencia de “laptop farms” en Reino Unido donde se concentran portátiles para hacer parecer que el operativo trabaja desde el país objetivo (Financial Times; Xataka). El periodo clave es 2020-2024, justo cuando el teletrabajo se expandió masivamente tras la pandemia, lo que facilita el anonimato. A nivel de impacto económico, el costo promedio de una filtración es alto: IBM apunta a un costo global promedio por brecha de seguridad de US$4,45 millones en su informe 2023 (IBM Security, Cost of a Data Breach Report 2023), una cifra que ilustra lo que está en juego si el ataque escala desde suplantación de personal a una brecha completa.

¿Cómo funciona la estafa y por qué engaña a las empresas?

El proceso empieza en la capa pública: perfiles laborales robados o creados, recomendaciones falsas y comunicaciones pulidas por modelos de lenguaje para evitar errores culturales o lingüísticos. La fase de entrevistas puede ser simulada con intermediarios reales o soluciones de vídeo que ocultan la identidad. La segunda fase es operar desde dispositivos enviados por la empresa: los portátiles remitidos permiten que el operativo ejecute tareas reales (cumple con entregables), cobre salarios y, opcionalmente, exfiltre datos o despliegue malware. Financial Times y fuentes de ciberseguridad resaltan que la contratación nunca fue tratada como un perímetro de seguridad; se gestionaba desde RRHH con controles de talento, no con controles técnicos de autenticidad (Financial Times). El resultado: una operación de bajo coste para el actor atacante y de alto riesgo para la víctima.

¿Cómo impacta esto en el mercado argentino?

La amenaza llega a pymes y startups que contratan talento remoto desde América Latina y a empresas globales con equipos distribuidos en Argentina. No es una hipótesis lejana: las tácticas explotan prácticas comunes en la región —envío de equipos a domicilio, verificaciones superficiales por video y dependencia de comunicaciones por mensajería—. Para una pyme que envía un portátil corporativo sin un proceso de provisión seguro, la pérdida no es solo el hardware: la exposición puede derivar en robo de propiedad intelectual o accesos a sistemas críticos. Además, la presencia de modelos de lenguaje en la cadena (usados para redactar perfiles y automatizar respuestas) obliga a exigir transparencia y auditorías, algo que ya pedimos para la normalización de modelos de IA en pymes y sectores sensibles. El mensaje para el mercado argentino es claro: lo que se gestiona desde RRHH debe integrar controles de seguridad TI y procesos verificables.

Controles prácticos para pymes y recursos humanos

Tenemos que transformar la contratación remota en un proceso mixto: talento + seguridad. Medidas accionables: 1) exigir verificación de identidad en dos pasos (video en vivo con tarea técnica), 2) provisionar dispositivos con MDM y cifrado antes del envío, 3) listas blancas de IP y VPN obligatoria para acceso a repositorios críticos, 4) cláusulas contractuales que permitan auditorías y logs, 5) pruebas aleatorias de autenticidad (pequeñas tareas técnicas supervisadas). Ejemplo rápido de ROI: si un responsable dedica 2 horas diarias a validar candidatos y una herramienta de verificación reduce eso a 30 minutos, se liberan ~45 horas/mes; si la hora del responsable vale sueldos locales, la herramienta se paga sola en semanas. No damos fórmulas mágicas: cada empresa debe estimar su propio costo/hora y su riesgo.

Cierre: qué pedimos desde la política y la práctica

Esto no es solo un problema técnico; es un problema de gobernanza. Exigimos transparencia de los proveedores de IA, pruebas independientes y auditorías antes de incorporar modelos en procesos de contratación y detección de identidad. Las pymes deben incorporar controles mínimos de seguridad en RRHH y exigir trazabilidad de los procesos de verificación. Si las plataformas de hiring y redes profesionales no actúan para frenar el abuso (cuentas usurpadas, automatizaciones que generan perfiles), las empresas pequeñas quedarán expuestas. La prevención es barata en comparación con una brecha: los números públicos —Department of Justice y reportes de costos de brechas— lo confirman.