OpenAI presentó Sora 2 y la app Sora el 23 de marzo de 2026, y afirma que todos los videos generados incluyen señales de procedencia visibles e invisibles y metadatos C2PA para trazabilidad. Según el comunicado oficial, muchas salidas llevarán marcas de agua dinámicas y la compañía mantiene herramientas internas de búsqueda reversa de imagen y audio para rastrear contenidos creados con Sora (OpenAI News, 23/3/2026).

Qué anunció OpenAI y por qué importa

OpenAI pone en el mercado una generación de video que combina detección de procedencia, marcas visibles e invisibles y controles de consentimiento para likenesses humanos. La compañía incorpora C2PA como sello de verificación, una iniciativa técnica y de gobernanza impulsada por la industria desde 2021 (C2PA, 2021). Este tipo de estándares responden a la demanda de autenticidad: no es lo mismo etiquetar que verificar de forma forense.

Los cambios también son prácticos: Sora 2 aplica guardrails más estrictos que los usados en la generación de imágenes, en atención a la mayor realismo que introduce el movimiento y el audio. Eso equivale, en palabras de OpenAI, a revisar prompts y outputs a lo largo de múltiples frames y transcripciones, y a mantener revisión humana sobre los casos de mayor riesgo (OpenAI News, 23/3/2026). En resumen, es una apuesta por combinar experiencia creativa con controles técnicos.

¿Cómo protegen la imagen y la voz de las personas?

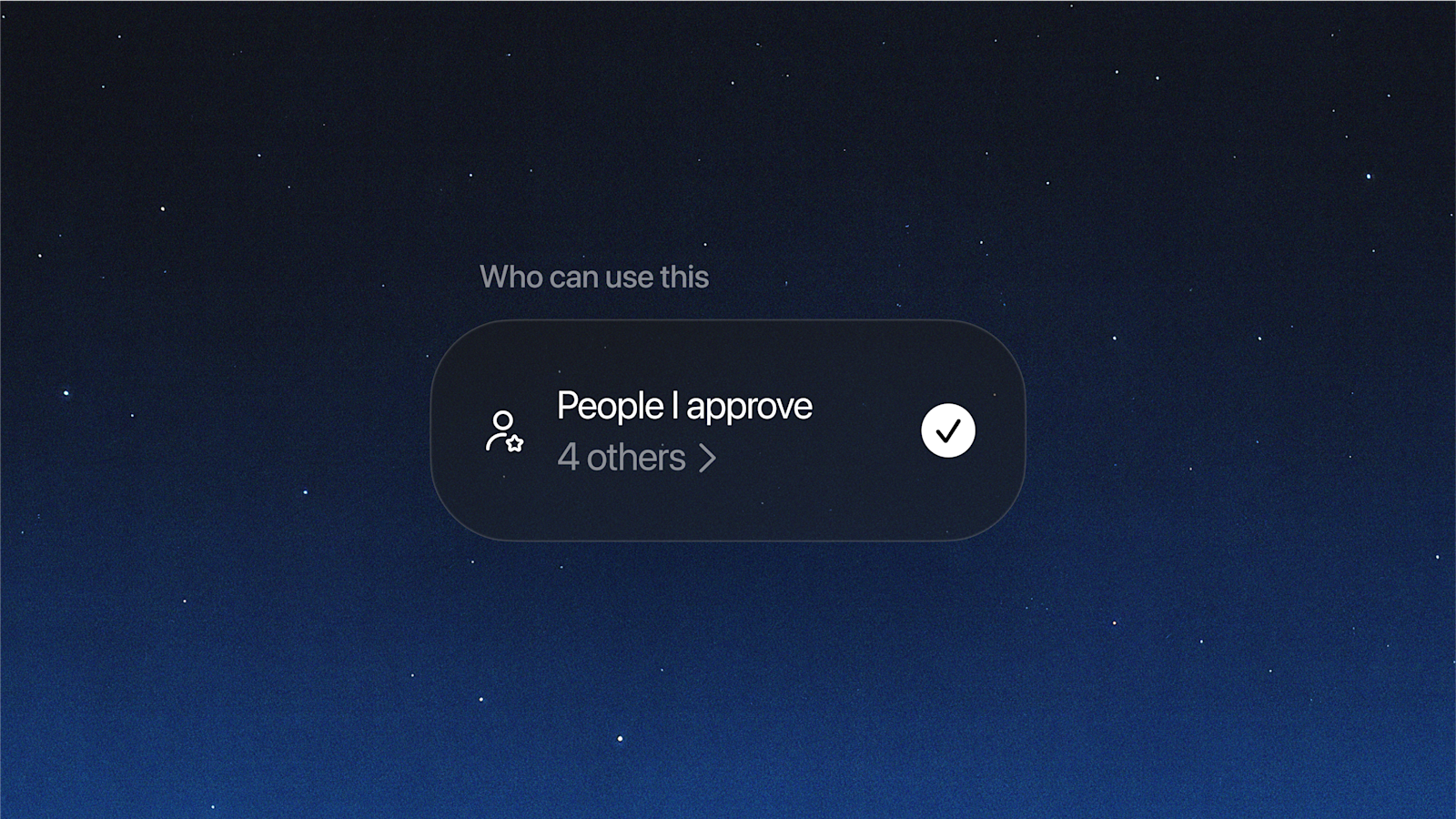

Sora permite generar video a partir de fotos de familiares y amigos siempre que el usuario certifique tener consentimiento de quienes aparecen, y aplica guardrails más estrictos para menores y para contenidos potencialmente dañinos. Además, ofrece una función de characters que almacena una representación de la apariencia y la voz que solo su propietario puede autorizar y revocar.

Estas medidas cubren dos vectores: la prevención proactiva en el momento de la generación y la remediación posterior, con reportes, borrado y bloqueo de personajes. La intención es limitar usos no consentidos, pero la eficacia práctica dependererá de dos cosas clave: la transparencia de métricas de falsos positivos/negativos y la rapidez de los procesos de remoción cuando se detecten abusos.

¿Cómo impacta esto en el mercado argentino?

Para empresas y creadores en Argentina Sora promete herramientas de edición de video potentes y accesibles, algo relevante en un país con industria audiovisual vibrante. Sin embargo, la adopción local depende de documentación y soporte en español, y de condiciones claras sobre datos y derechos. Vemos ecos de esa demanda: plataformas globales que operan aquí suelen necesitar manuales, políticas y recursos de moderación en español para ser realmente útiles.

Además, la escala contextual importa: recordemos que la IA conversacional llegó rápido a masas —ChatGPT alcanzó 100 millones de usuarios mensuales en enero de 2023, según informes de prensa— y con ello surgieron problemas de uso indebido que tomar tiempo en regular y mitigar (The New York Times, enero 2023). Para el mercado argentino eso significa evaluar costos, requisitos legales de consentimiento y la capacidad de moderación en español antes de integrar Sora en flujos de trabajo.

Riesgos, límites y qué exigir antes de adoptarlo

Sora incorpora detección de imitaciones musicales, filtros por edad y revisión humana focalizada, pero sigue habiendo riesgos materiales: uso no consentido de likeness, deepfakes con fines políticos o extorsivos, y errores en la clasificación automática. OpenAI menciona red teaming y actualizaciones continuas, lo cual es positivo, pero insuficiente sin métricas públicas sobre fallos y tiempos de respuesta.

Exigimos tres cosas concretas antes de una adopción masiva: 1) métricas públicas y verificables sobre precisión de detección, tasas de falsos positivos/negativos y tiempos de remoción; 2) documentación técnica y guías de uso en español para usuarios y moderadores; 3) gobernanza que incluya revisión humana en banderas críticas y canales claros de apelación. Sin esos elementos, la tecnología puede llegar antes que las garantías necesarias. En ese sentido, aplaudimos las señales técnicas anunciadas, pero pedimos datos y procedimientos concretos para confiar en su despliegue amplio.