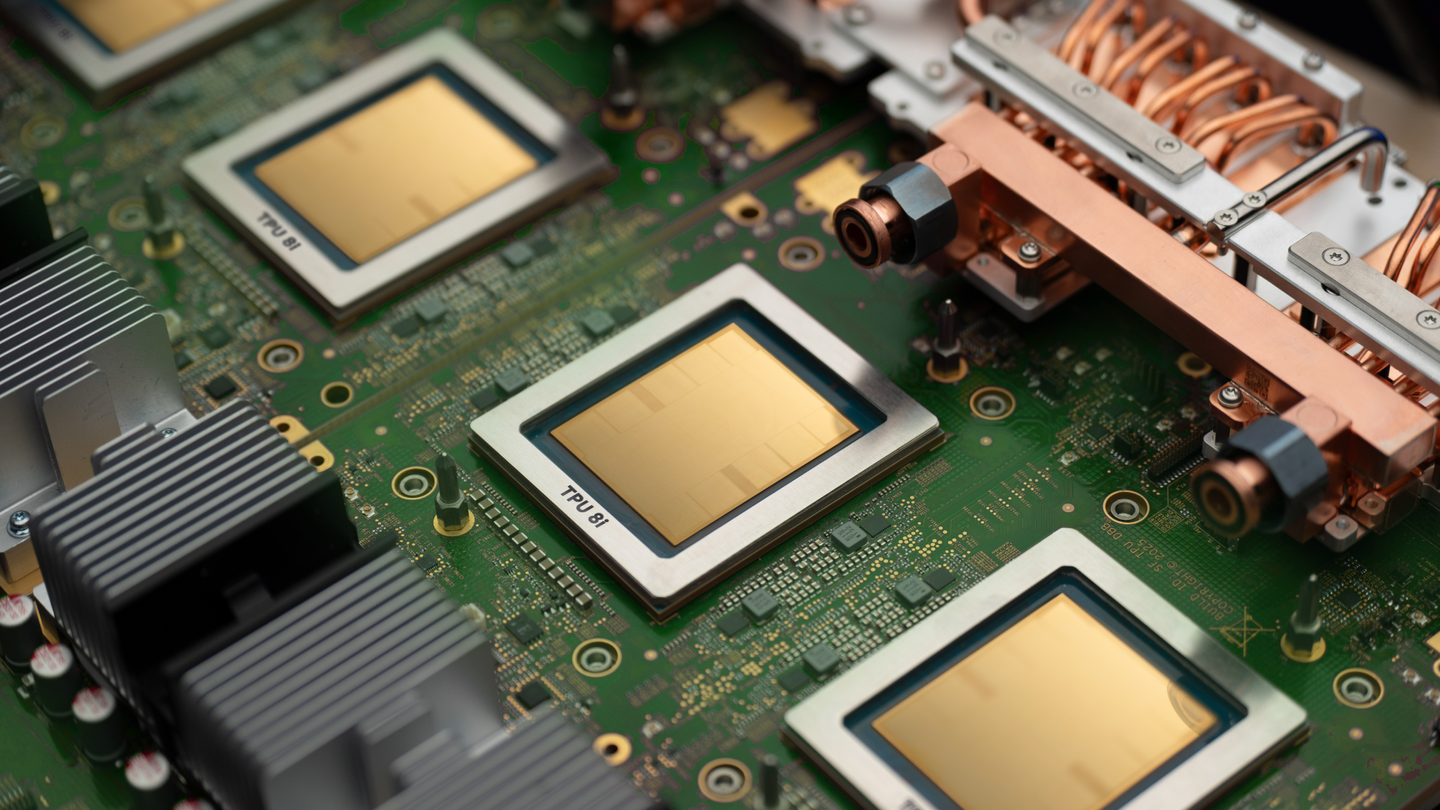

El anuncio responde a una necesidad concreta: el 22/4/2026 se presentaron dos chips TPU llamados 8i y 8t, pensados respectivamente para inferencia de baja latencia y para entrenamiento en una sola “piscina” de memoria masiva, según el comunicado oficial (fuente: comunicado, 22/4/2026). Esta primera frase resume el qué y el cuándo; el resto del artículo analiza para quién sirve esto y qué condiciones pedimos para su adopción responsable.

¿Qué están anunciando exactamente?

La nota oficial dice que hay dos TPUs: TPU 8i, diseñado para que agentes autónomos completen flujos multi‑paso “muy rápidamente”, y TPU 8t, optimizado para entrenar modelos complejos en una sola piscina de memoria masiva (fuente: comunicado, 22/4/2026). El anuncio incluye tres datos visibles: los nombres de producto (8i y 8t), la fecha del comunicado (22/4/2026) y la idea de una arquitectura con “una” piscina de memoria centralizada (fuente: comunicado, 22/4/2026). Vemos una apuesta clara a priorizar experiencia de usuario (latencia) en paralelo con capacidad de entrenamiento en el mismo ecosistema de infraestructura. Esto no nos dice aún cuánto consumo energético tendrán ni el tamaño real de esa memoria, datos que pedimos sean públicos antes de cualquier adopción masiva.

¿Por qué importa para la “era agentica”?

Los agentes autónomos requieren que el sistema razone, planifique y ejecute pasos encadenados sin fricciones para el usuario. En teoría, hardware orientado a baja latencia mejora la sensación de inmediatez; hardware con gran memoria facilita modelos que mantienen contexto prolongado, algo clave para coordinar múltiples tareas. El comunicado repite la prioridad en ambos frentes (fuente: comunicado, 22/4/2026). Sin embargo, la promesa técnica no equivale a impacto real: necesitamos cifras comparables de latencia, throughput y consumo por tarea, y datos sobre costos por hora de instancia en la nube. Hasta ahora la comunicación ofrece nombres y objetivos, no métricas reproducibles; por eso pedimos que esos números sean públicos y verificables.

¿Cómo impacta esto en el mercado argentino?

En la práctica, la gran mayoría de pymes y desarrolladores en Argentina no van a comprar chips físicos: accederán vía la nube del proveedor que despliegue estas TPUs. Eso significa que el impacto local dependere de dos variables medibles: disponibilidad regional de instancias y precio por hora en la región. El anuncio del 22/4/2026 no detalla despliegue por país ni precios (fuente: comunicado, 22/4/2026). Por lo tanto, para que las empresas argentinas puedan evaluar adopción hace falta información traducida y contextualizada: documentación técnica en español, benchmarks reales ejecutados en condiciones locales y transparencia sobre requerimientos energéticos, algo crítico dada la infraestructura eléctrica regional.

Riesgos, condiciones y nuestro pedido explícito

Hay ventajas claras si la latencia baja y la memoria permite modelos más largos, pero hay riesgos concretos: concentración de poder en quien controla el acceso al hardware, opacidad en métricas de performance y externalidades energéticas. Por eso mantenemos tres exigencias concretas y no negociables: 1) métricas públicas y reproducibles sobre latencia, throughput, consumo y costo (fuente: postura editorial 22–23/4/2026), 2) documentación técnica en español para desarrolladores y reguladores (fuente: postura editorial 22–23/4/2026), y 3) gobernanza con revisión humana antes de adopciones masivas, incluyendo auditorías independientes (fuente: postura editorial 22–23/4/2026). Sin esos tres puntos, la promesa de hardware para agentes será más marketing que infraestructura democráticamente útil.

En resumen, el 22/4/2026 se anunció una apuesta por acelerar agentes con TPU 8i y 8t; la noticia es relevante, pero su valor público depende de cifras y políticas que hoy no vimos en el comunicado. Pedimos esas cifras y políticas con urgencia para que la adopción no sea solo técnica, sino responsable y accesible para la región (fuente: comunicado y postura editorial, 22–23/4/2026).