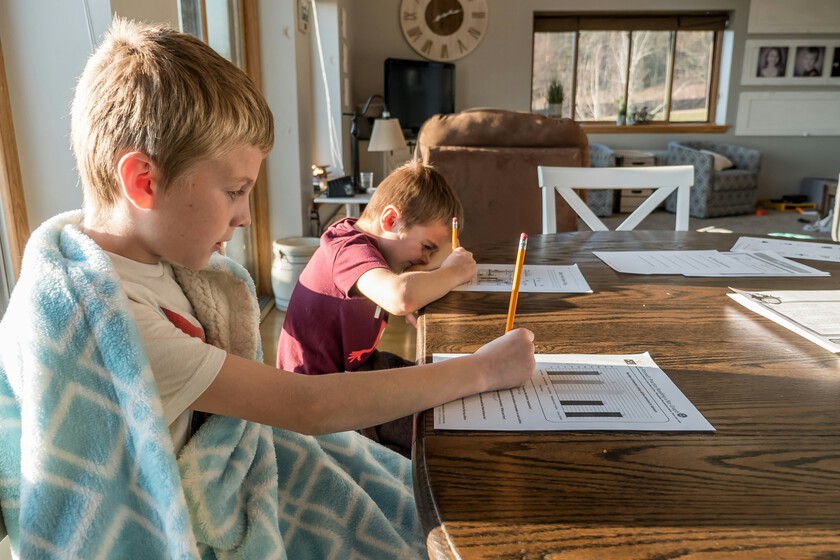

La inteligencia artificial generativa ya cambia qué tareas sirven para aprender: muchas tareas que antes se mandaban para hacer en casa pueden resolverse en segundos con herramientas como ChatGPT (lanzado el 30 de noviembre de 2022, OpenAI) y que alcanzó 100 millones de usuarios en enero de 2023 (The New York Times, feb 2023).

¿Se acaban los deberes tal como los conocíamos?

Lo que antes medía esfuerzo en casa ahora mide, a veces, la habilidad para pedirle a una IA que haga el trabajo. En el artículo de Xataka (4/4/2026) varios docentes cuentan que los alumnos usan asistentes como ChatGPT o Gemini para resúmenes y redacciones. Frente a eso, la respuesta rápida ha sido traer las tareas al aula o pedir entregas en tiempo real.

Esta transformación ocurre sobre un fondo tecnológico palpable: ChatGPT creció muy rápido tras su lanzamiento (100 millones de usuarios en dos meses, The New York Times, feb 2023), más rápido que muchas aplicaciones de consumo históricas. Eso cambia la ecuación entre lo que se pide para hacer en casa y lo que demuestra aprendizaje real.

Qué están haciendo los docentes

Los profesores están ajustando: más ejercicios presenciales, más orales, y tareas que requieran demostrar el proceso. En el instituto citado por Xataka, los comentarios de texto volvieron a clase tras detectar uso de IA. Algunas universidades ya recomiendan tareas “resistentes a la IA” según las indicaciones de la Universidad Complutense de Madrid citadas en el mismo artículo (Xataka, 4/4/2026).

También aparecen herramientas de detección, aunque los docentes son conscientes de sus límites y del coste en tiempo que implica verificar. El problema práctico es logístico: convertir una entrega escrita en una exposición consume clases y tiempo de temario. Aquí entra la decisión de priorizar qué aprendizaje vale la pena verificar presencialmente.

Riesgos reales: delegar el pensamiento

El daño más profundo no es solo copiar: es perder el proceso de leer, contrastar y decidir. En primaria y secundaria, la corteza prefrontal aún madura, por eso docentes citados en el artículo alertan que el uso acrítico de respuestas generadas puede impedir el desarrollo del pensamiento crítico. Además, el acceso temprano a estas herramientas es real: muchos chicos tienen smartphone desde edades tempranas; por ejemplo, en Estados Unidos el 95% de los adolescentes reportó acceso a un teléfono inteligente (Pew Research Center, 2022), dato que ayuda a entender la difusión global del problema.

La clave: distinguir entre ahorro de tiempo legítimo (borradores, rúbricas) y sustitución del esfuerzo cognitivo. Cuando la IA sustituye el proceso, no queda «poso» en el aprendizaje, como señalan varios docentes en el reporte (Xataka, 4/4/2026).

Qué conviene hacer en las escuelas (y en tu casa)

No proponemos volver atrás ni prohibir la tecnología. Proponemos diseño pedagógico con criterios claros: tareas que muestren proceso, evaluaciones en aula, y pautas de uso justificadas. También pedimos medidas de gobernanza tecnológica: trazabilidad de las herramientas usadas, control de permisos y un plan de salida antes de automatizar o almacenar datos sensibles, en coherencia con nuestra postura editorial sobre IA.

Para las familias, la recomendación es similar: enseñar a usar la IA como apoyo (verificar fuentes, pedir explicaciones paso a paso) y no como atajo final. Si un docente pide trabajo a mano y eso resulta fácil de eludir, la respuesta no puede ser solo sanción; necesita conversación sobre por qué se pide y qué se busca evaluar.

Si llegaste hasta acá, ya tenés lo más difícil hecho: entender que la pregunta no es si la IA entra en la escuela, sino cómo la escuela redefine qué significa aprender cuando las respuestas están a un “prompt” de distancia (Xataka, 4/4/2026).