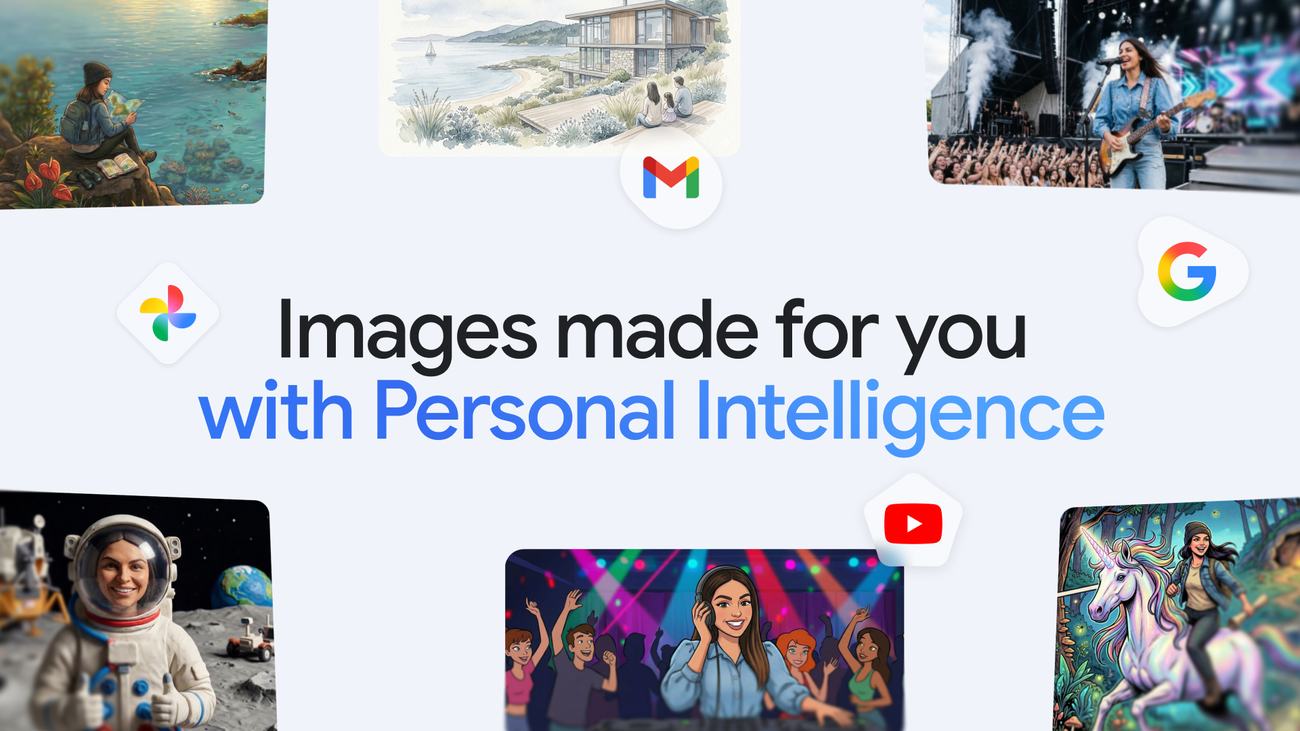

Gemini ahora puede crear imágenes personalizadas utilizando tu librería de Google Photos y tus preferencias, sin que tengas que subir fotos manualmente ni escribir prompts extensos (anuncio oficial de Google, 16/04/2026). Esta es la novedad central: pedir una escena con vos o tus seres queridos será posible con instrucciones simples porque el sistema extrae contexto de las apps que vinculaste.

Qué anunció Google y por qué importa

Google presentó la función Personal Intelligence integrada en la app Gemini, que usa el motor Nano Banana 2 para combinar preferencias y fotos personales y generar imágenes más ‘tuyas’ (según el post oficial de Google, 16/04/2026). La compañía dice que la experiencia elimina la necesidad de describir detalles de la vida o de subir y re-subir fotos de referencia; basta un prompt sencillo. Además, Google aclara que la función se ofrece a suscriptores de Google AI Plus, Pro y Ultra —tres niveles de acceso— en primera instancia (según Google). Desde la perspectiva técnica, esto reduce la fricción de uso: menos pasos para obtener resultados coherentes con el historial del usuario. Vemos aquí una apuesta clara a la personalización integrada, que puede aumentar el uso creativo, pero también concentra más datos personales en un mismo ecosistema.

¿Cómo impacta esto en Argentina?

Por ahora la nueva experiencia se está desplegando en EE. UU. para suscriptores elegibles; Google dice que planea ampliar el acceso a escritorio y más usuarios después (según Google, anuncio 16/04/2026). En Argentina esto importa por dos razones prácticas: primero, muchas funciones de Google llegan con retraso regional —eso implica una ventana de adopción y adaptación técnica—; segundo, la mayoría de los usuarios locales esperan interfaces y documentación en español para aprovechar completamente la herramienta. Si Google trae la función aquí, las organizaciones y creadores locales podrían reducir tiempos de producción de imágenes personalizadas. Sin embargo, la adopción real dependerá de la disponibilidad regional y de la existencia de materiales y soporte técnico en español, un requisito que ya hemos exigido públicamente en anuncios previos sobre productos de Google.

Privacidad, control y qué pedimos antes de adopción amplia

Google afirma que Gemini no entrena sus modelos directamente con tu librería privada de Google Photos y que la conexión es opt-in (según el comunicado oficial de Google, 16/04/2026). Eso es relevante, pero no suficiente: necesitamos métricas públicas que muestren qué datos se procesan, por cuánto tiempo se retienen y con qué propósitos secundarios (telemetría, mejora de modelos, etc.). Además apoyamos el despliegue técnico responsable —tal como dijimos sobre AI Mode en Chrome— y repetimos la demanda de documentación en español y mecanismos de gobernanza con revisión humana antes de adopción masiva. Pedimos también trazabilidad: un botón que muestre exactamente qué foto usó el sistema y un registro de cambios que sea fácil de auditar por usuarios y reguladores.

Qué observar en las próximas semanas

En lo inmediato conviene chequear tres cosas cuando la función llegue a nuestra región: disponibilidad regional y precios, la existencia de documentación y tutoriales en español, y la publicación de métricas de privacidad y rendimiento por parte de Google. También hay que vigilar cómo responde la oferta a errores: Google permite refinar resultados y cambiar la foto de referencia en la app, una función de control que es necesaria pero que no reemplaza transparencia sobre el procesamiento de datos. Nosotros apoyamos la llegada de herramientas que faciliten la creación, siempre que vengan acompañadas por métricas públicas, documentación en español y gobernanza con revisión humana antes de adopción amplia (posición consistente con declaraciones previas sobre Google).