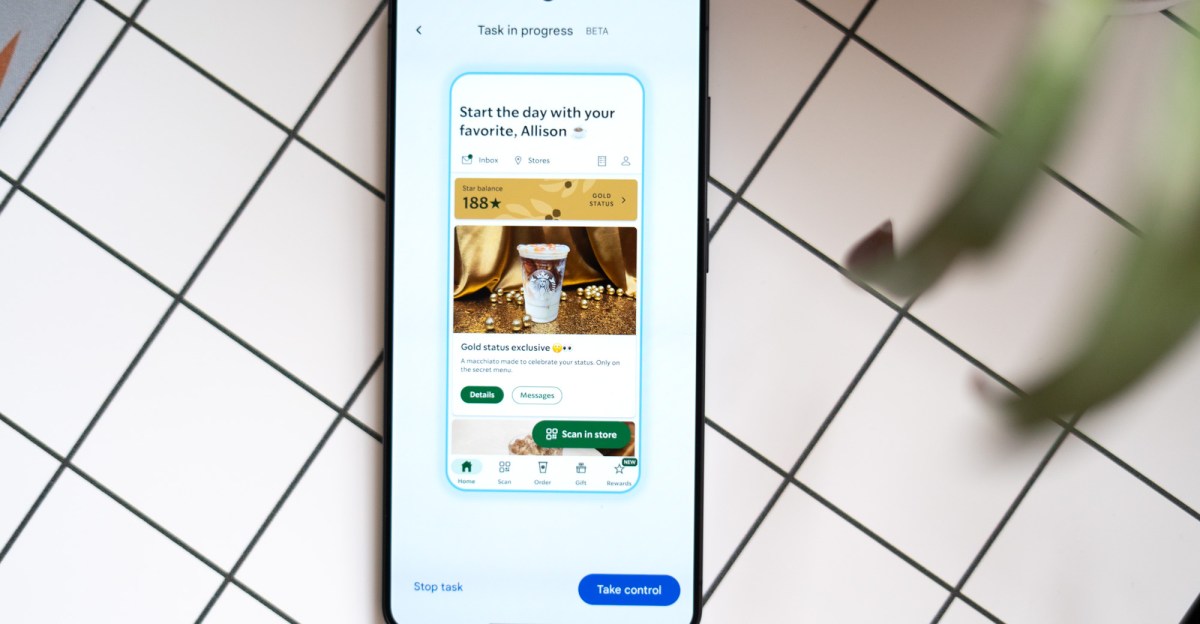

Gemini ahora puede tomar el control de aplicaciones en el teléfono para, por ejemplo, armar un pedido en Uber Eats o reservar un viaje en Uber: es la primera vez que vemos un asistente hacer esto en un móvil fuera de demos controladas, pero lo hace de forma lenta y todavía poco fiable (The Verge, 21/3/2026).

¿Qué hace Gemini y por qué importa?

Gemini da pasos prácticos hacia un asistente que no solo responde con texto, sino que interactúa con apps por nosotros. En el análisis publicado por The Verge se probó la función en un Pixel 10 Pro y en un Galaxy S26 Ultra; la automatización está limitada hoy a “un puñado” de servicios de delivery y rideshare y sigue en beta (The Verge, 21/3/2026). Vemos que la novedad no es solo técnico-estética: cuando Gemini tiene acceso a correo y calendario puede buscar un vuelo y proponer horarios —en una prueba armó una sugerencia de salida sin que el usuario diera todos los detalles—, lo que sube la utilidad práctica del asistente (The Verge, 21/3/2026). Esta capacidad es relevante porque traslada parte del trabajo de toma de decisiones rutinarias del humano al software, liberando tiempo para otras tareas.

¿Cómo funciona y dónde falla?

La arquitectura actual de la función es de “razonamiento sobre interfaces humanas”: Gemini lee la pantalla, toca y desplaza como lo haría un usuario para completar pasos. Eso la hace frágil: se confunde con anuncios, fotos grandes o menús mal etiquetados y a veces no explica por qué falló. En el ensayo de The Verge, armar un pedido de teriyaki tomó alrededor de 9 minutos; programar un viaje en otra prueba demoró cerca de 3 minutos (The Verge, 21/3/2026). Además, el sistema por ahora se detiene antes de confirmar la compra —la confirmación manual es el salvavidas— y en cinco días de pruebas nunca completó un pedido sin intervención (The Verge, 21/3/2026). Google acepta que este razonamiento es un parche hasta que haya APIs más robustas: la industria trabaja en Model Context Protocol (MCP) y Android App Functions para ofrecer datos estructurados a asistentes y evitar que tengan que «navegar» interfaces pensadas solo para humanos (comentado por Sameer Samat en la nota, The Verge, 21/3/2026).

¿Cómo impacta esto en el usuario argentino?

Hoy la función está atada a modelos de apps y dispositivos específicos; eso limita su efecto en Argentina mientras los fabricantes y desarrolladores locales no implementen APIs compatibles. En la práctica, si el asistente solo entiende ciertos menús y permisos técnicos, su utilidad se reduce donde las apps locales usan interfaces diferentes. Además, el idioma es clave: exigimos documentación y mensajes en español para que los usuarios y equipos de soporte puedan auditar comportamientos y errores. Para empresas y gobiernos esto implica dos trampas: creer que el asistente ya está listo para despliegues masivos, o prohibir la tecnología sin antes exigir métricas claras de rendimiento y privacidad. En las pruebas citadas, Gemini detectó mal ubicaciones de delivery usadas previamente o pidió permisos de ubicación, errores típicos cuando un sistema intenta operar fuera del contexto donde fue entrenado (The Verge, 21/3/2026).

Qué pedimos a Google y a los desarrolladores

Vemos la función como un avance técnico importante pero todavía experimental. Por eso pedimos tres requisitos antes de adopciones masivas: métricas públicas de precisión y fallos (por ejemplo, tasa de errores por tarea, tiempo promedio por automatización), documentación en español que describa permisos y límites, y gobernanza con revisión humana para evitar órdenes automáticas peligrosas. Nuestra postura coincide con lo que venimos sosteniendo sobre Google: apoyamos la consolidación técnica, pero exigimos métricas públicas, documentación en español y controles humanos antes de adoptar estas funciones a escala. Si Google publica esos indicadores y los SDK abiertos para que desarrolladores locales implementen MCP o App Functions, podríamos pasar de una demo torpe a una herramienta útil en varios mercados, incluido Argentina.

En resumen: Gemini en el teléfono es lento y a veces ridículo, pero ofrece la primera muestra real de cómo serán los asistentes móviles que actúan en apps. Eso merece entusiasmo crítico: no lo aceptamos como producto final, sino como una plataforma que necesita transparencia técnica y regulación práctica para ser útil y segura.