Un estudio conjunto del MIT, la Universidad de California, Oxford y Carnegie Mellon concluye que la asistencia de IA puede reducir la persistencia y perjudicar el rendimiento independiente cuando se retira la herramienta; los experimentos usaron un bot basado en GPT-5 y la interrupción ocurrió a los diez minutos de prueba (según la nota del 17/4/2026). El hallazgo central es práctico y directo: la disponibilidad de respuestas inmediatas cambia no solo el resultado final, sino la disposición a intentar las tareas cuando la ayuda desaparece.

¿Qué midieron exactamente y cómo lo hicieron?

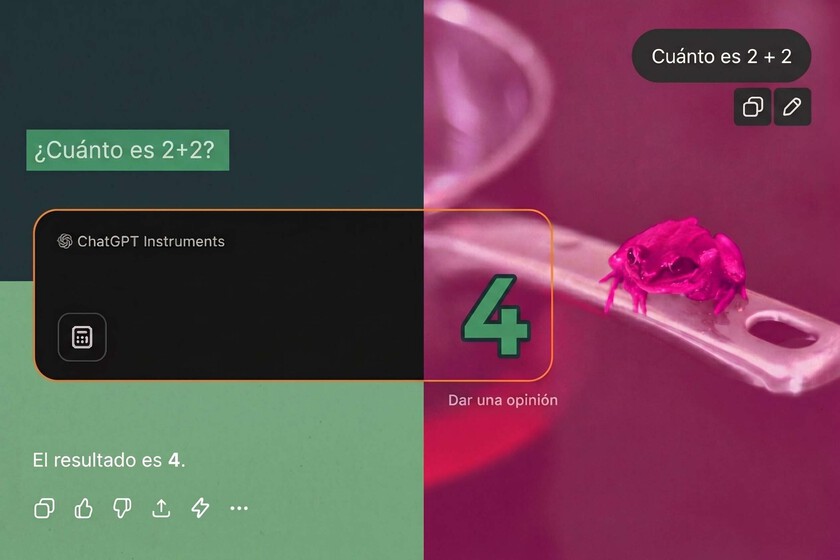

Los investigadores realizaron tres experimentos con tareas distintas: resolución de ecuaciones (350 participantes), razonamiento lógico (670 participantes) y comprensión lectora (200 participantes) (según el estudio conjunto publicado 17/4/2026). A una parte de la muestra se le permitió acceder al chatbot durante la prueba; a la mitad del examen el acceso fue cortado a los diez minutos, lo que permitió comparar rendimiento y perseverancia antes y después de la interrupción. El diseño busca identificar no solo errores en las respuestas, sino la disposición a continuar intentando cuando la ayuda desaparece (antes vs. después del corte). La repetición en tres dominios distintos (matemáticas, lógica y lectura) fortalece que el efecto no es exclusivo de una tarea puntual.

¿Nos vuelve perezosos o dependientes la IA?

Vemos que no es magia ni fatalidad: la dependencia depende del uso. Según la nota, quienes pedían la “respuesta fácil” tendieron a abandonar más rápido cuando se les quitó el chatbot, mientras que quienes solicitaban explicaciones o pasos mantuvieron mejor su desempeño. Ese matiz es clave para no demonizar la herramienta. El experimento muestra una comparación temporal clara: con acceso a la IA el rendimiento es más alto en el corto plazo, pero al retirar la asistencia el rendimiento y la perseverancia caen frente a quienes no dependieron de la IA desde el inicio. Eso configura un riesgo de atrofia de la práctica si la IA sustituye ejercicios que antes forzaban la práctica independiente.

¿Y qué implica esto para las aulas y la formación en Argentina?

Si vos trabajás en educación, la lección es de diseño. El estudio sugiere que la integración de chatbots en la escuela debe conservar la práctica deliberada: tareas con restricciones, pedir pasos intermedios y ejercicios sin asistencia. En la nota se advierte además sobre la tendencia paralela de consumo de contenido corto —por ejemplo, fragmentos pensados para enganchar en 15 segundos— que también condicionan la atención y el hábito de esfuerzo (según la misma fuente, mención a formatos de 15 segundos). Para políticas educativas locales, recomendamos pruebas controladas en aulas piloto, medidas de evaluación antes/después y formación docente para distinguir uso explicativo de uso sustitutivo. Si la IA se usa como tutor que explica procesos (no sólo da respuestas), el riesgo de dependencia disminuye.

Qué medidas prácticas recomendamos ahora

Recomendamos tres líneas concretas y simples: 1) En tareas formativas, exigir que el alumno entregue el proceso, no solo la respuesta; 2) alternar actividades con y sin asistencia de IA para preservar la práctica deliberada; 3) medir impacto con experimentos locales antes de masificar. Estas medidas respetan el axioma de que la herramienta es un medio, no un fin: usar la IA para explicar (y no para sustituir la práctica) es lo que mostró mejores resultados en el experimento. Si llegaste hasta acá, ya tenés lo más difícil: entender que la decisión no es prohibir, sino diseñar cómo y cuándo usar la IA para que no nos “cueza” sin darnos cuenta.