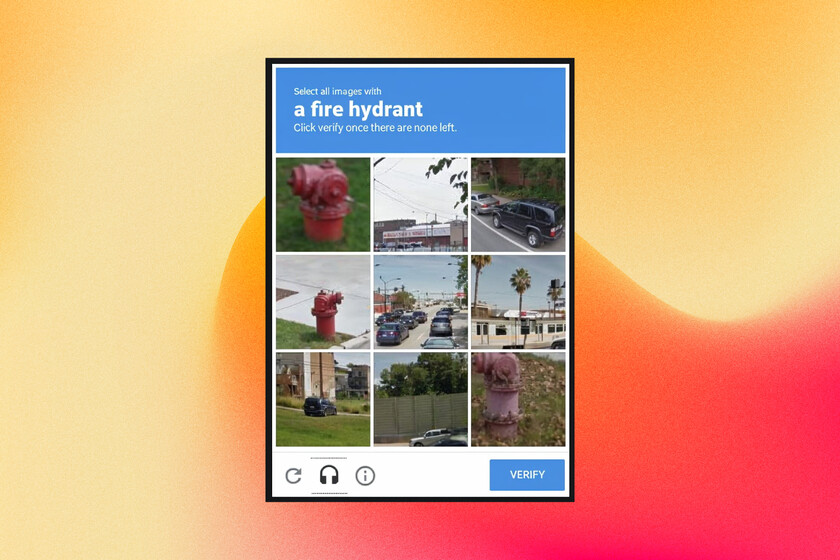

Desde hace años, cada vez que marcamos una cuadrícula para identificar semáforos o bocas de incendio no sólo “probamos” que somos humanos: estamos alimentando modelos de IA de empresas grandes. Esa transformación no es menor: Google compró reCAPTCHA en 2009 y desde entonces ha usado las respuestas humanas para convertir microtrabajo no remunerado en datos de entrenamiento (anuncio de Google / cobertura de prensa, 2009). Este dato resume la tensión: herramientas de seguridad que producen datos comerciales valiosos sin compensación directa al usuario.

¿Por qué no es sólo un juego de imágenes?

El sistema comenzó como una defensa contra bots y terminó como una fábrica de etiquetas. reCAPTCHA probó ser útil para digitalizar texto y mejorar mapas; después evolucionó hacia reCAPTCHA v3, lanzado en 2018, que ya no pide puzzles visibles sino que puntúa el comportamiento del visitante (Google Security Blog, 2018). Ese sistema devuelve una puntuación entre 0.0 y 1.0 para estimar riesgo y decidir si el visitante es humano (documentación de Google reCAPTCHA). En la práctica, eso significa que, en lugar de resolver una imagen, nuestra navegación —movimientos del ratón, cookies, tiempo en página— se convierte en la señal. La pregunta relevante no es técnica: es de propiedad y consentimiento. ¿Por qué un servicio de protección puede generar valor comercial masivo sin mecanismos claros de compensación ni transparencia sobre qué se entrena con esos datos?

¿Cómo impacta esto a un emprendedor o pyme en Argentina?

Para una tienda o app en Argentina la consecuencia es doble. Por un lado, usar soluciones probadas como reCAPTCHA reduce fraudes y mantiene la plataforma operativa; por el otro, se está cediendo datos conductuales que alimentan modelos propietarios de gigantes tecnológicos. Desde 2018 vimos el cambio operativo: menos fricción para el usuario pero más opacidad sobre qué se comparte (comparación: captchas visibles vs. scoring invisible desde 2018). Eso importa en LATAM porque las pymes pagamos en tiempo y datos: cada integración con herramientas globales puede transferir datos a servicios que operan fuera de la regulación local. No hay cifras exactas públicas sobre cuánto valor extra genera esta práctica a los grandes, pero sí hay evidencia pública de la línea temporal (adquisición en 2009 y reCAPTCHA v3 en 2018) y del mecanismo técnico (puntuación 0.0–1.0, según documentación oficial de Google).

¿Qué pedimos y qué deberían exigir los gobiernos y las empresas?

La postura es clara y coherente con nuestras demandas previas sobre IA: exigimos transparencia, auditorías independientes y pruebas antes de normalizar el uso de modelos entrenados con datos derivados de captchas o telemetría de usuarios. Las pymes no pueden ser campo de pruebas opacas. Un umbral práctico: todo proveedor que entregue herramientas de verificación automática debería publicar un informe de datos (qué se recolecta, retención, usos de entrenamiento) y someterse a una auditoría externa anual. Además, los contratos entre plataformas y comercios deberían especificar derechos sobre los datos derivados de la actividad del cliente. Si una administración pública despliega sistemas semejantes, la exigencia debe ser aún mayor: pruebas independientes y acceso controlado a los datos.

Cierre: qué hacer mañana

Para el emprendedor: revisar integraciones y cláusulas de proveedor, pedir transparencia y considerar alternativas locales si la política de datos no es clara. Para reguladores: pedir a los proveedores informes públicos y auditorías. No se trata de demonizar una tecnología que reduce fricción; se trata de cerrar la asimetría: que quienes generan datos —los usuarios— no queden como proveedores no remunerados de entrenamiento para modelos privados sin controles. Exigimos las mismas reglas que hemos pedido antes para IA: transparencia, pruebas independientes y auditorías antes de normalizar estas prácticas en pymes y en la administración pública.