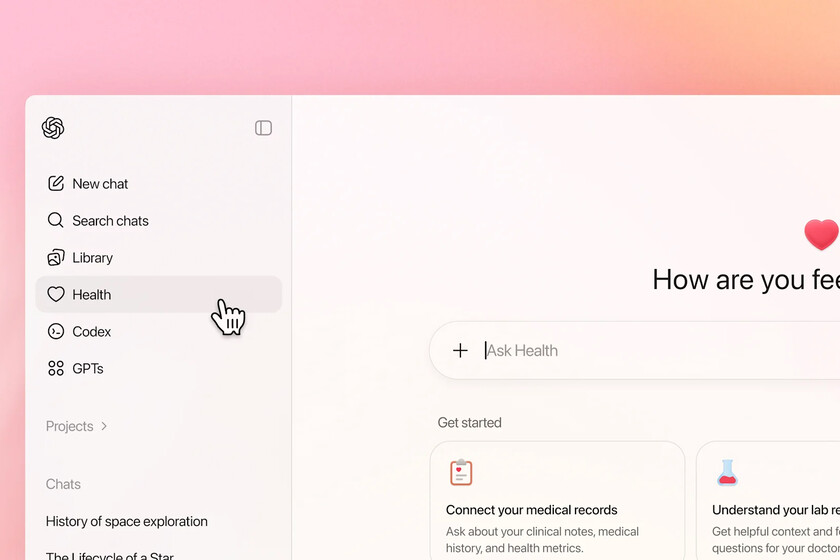

OpenAI lanzó a inicios de 2026 un modo salud de ChatGPT que, según un estudio publicado en Nature Medicine y recogido por NBC News, erró al clasificar la urgencia del 51,6% de los casos de emergencia presentados. Este dato central obliga a preguntarnos si el asistente cumple su promesa de ayudar a la primera línea de consulta: la respuesta por ahora es no, al menos en los escenarios que evaluaron los investigadores.

Qué encontró el estudio

El trabajo —citado por NBC News el 9/3/2026— presentó al modelo miles de escenarios clínicos y observó dos fallos simétricos. Por un lado, el sistema infravaloró situaciones críticas, sugiriendo esperar 24–48 horas en cuadros que requerían atención urgente; la tasa de error en la clasificación de urgencia fue 51,6% (Nature Medicine, citado por NBC News, 9/3/2026). Por otro lado, en síntomas leves el modelo sobreestimó la necesidad de consulta rápida en 64,8% de los casos (Nature Medicine, citado por NBC News, 9/3/2026). Además el estudio incluyó casos con ideación suicida: el banner de ayuda apareció cuando solo se describían síntomas, pero desapareció en algunos casos al añadir resultados de laboratorio, lo que los autores consideraron una falla de la barrera de protección (Nature Medicine / NBC News).

¿Puede pasarnos en Argentina?

Sí. Chatbots y asistentes de salud no distinguen por ubicación geográfica: si una app o servicio es accesible desde un celular en Argentina, los riesgos técnicos se replican. El modo salud de ChatGPT está disponible en EEUU pero no en España, según la nota original; aun así, la penetración de chatbots en consultas informales crece: la gente que antes googleaba ahora pregunta a un bot. Esa práctica cambia el punto de decisión sobre ir a una guardia. Si un sistema subestima urgencias en 51,6% de casos en un estudio controlado, ese margen de error puede traducirse en retrasos de atención reales aquí. Además, la variación en protocolos clínicos y acceso a servicios en Latinoamérica amplifica el efecto: una recomendación de esperar 48 horas puede tener consecuencias más graves donde el sistema de salud es menos accesible.

Qué debería hacer OpenAI y los reguladores

Vemos el avance técnico, pero exigimos más transparencia y control. OpenAI respondió que ChatGPT Health no pretende diagnosticar sino apoyar con preguntas de seguimiento (declaración citada por The Guardian), pero eso no exime a la compañía de responsabilidades operativas. Pedimos tres medidas concretas: 1) publicar métricas públicas y datasets reproducibles para auditoría independiente; 2) garantizar disponibilidad regional responsable antes de desplegar funciones en nuevos mercados; 3) establecer gobernanza clara sobre revisión humana de casos críticos y uso comercial de datos de salud. Estas demandas coinciden con posiciones previas sobre la necesidad de métricas públicas y gobernanza clara (nuestro registro editorial, marzo 2026).

Qué pueden hacer los usuarios ahora

Hasta que haya mejoras verificables, recomendamos precaución. Primero, no usar un chatbot como sustituto de la consulta urgente: ante síntomas graves acudir a emergencias o servicios de salud locales. Segundo, cuando consulte un asistente de IA, buscar confirmación humana y documentación oficial —no basar decisiones solo en la respuesta del bot. Tercero, reportar inconsistencias y compartir capturas con profesionales para crear evidencia clínica de fallos. La tecnología puede ayudar, pero mientras un estudio muestre 51,6% de errores en triage y 64,8% de sobrediagnóstico, la prudencia clínica debe primar (Nature Medicine / NBC News, 9/3/2026).